거북목개발자

Machine Learning 기초 본문

오류가 있을수도 있으며 댓글로 남겨주시면 바로 수정하겠습니다 ^.^

참고한 문서는 <유튜브 - 모두의 딥러닝 시즌1> https://youtu.be/BS6O0zOGX4E 과

대학교 강의시간에 배운 내용을 바탕으로 작성하였습니다.

<Supervised>

- learning with labeled examples

- 이미지 라벨링, 이메일 스팸 필터, 성적 예측 ...

- ex) 개, 고양이 분류 모델

- Regression ex) 시험 성적 예측(0~100점)

- Binary Classification ex) 시험에서 pass / non-pass (둘 중에 하나 예측)

- Multi-label Classification ex) 시험에서 (A, B, C, E and F) (여러가지 종류 중 예측)

-> input data로 discrete한 값을 예측하면 Classification

-> input data로 continuous한 값을 예측하면 Regression

Linear Regression은 input data에 따른 output data의 관계를 1차원 방정식으로 구하는 것이다.

Logistic Regreesion은 input data에 대한 output data의 관계를 직선으로 알맞게 나타내지 못하는 경우가 많다.

이를 보완한것이다.( Linear Regression에 non-linear한 특성을 추가)

지도 학습은 크게 분류와 회귀 두 가지 유형으로 나눌 수 있다.

이 두 가지 기법의 가장 큰 차이점은 분류는 예측 값이 카테고리와 같은 이산형 클래스(ex.타이타닉 생존의 라벨인 0,1)이고 회귀는 연속형 숫자값(ex.매출)이다.

(출처 : https://john-analyst.medium.com/%ED%9A%8C%EA%B7%80-regression-%EB%9E%80-398c548e1560)

<Unsupervised>

- learning with un-labeled examples

- ex) Google news grouping

<Linear Regression>

1. 가설 세우기

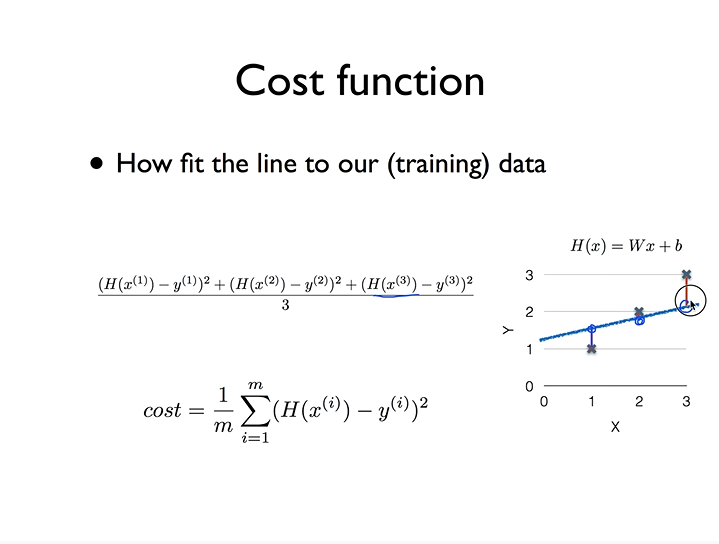

2. 어떤 가설이 좋은지 정하는 법은? -> Cost Function (Loss Function) 사용해서 구한다.

3. Cost Function

Cost Function은 w와 b의 Function

목표 : Cost Function을 가장 작게 하는 W와 b 찾기

<Cost Function을 Minimize 하는 법>

- Cost 함수가 최소화 되는 곳을 구해야됨 -> Gradient Descent Algorithm

- Gradient Descent Algorithm (경사 하강법)

: 항상 최저점에 도달할 수 있다.

: Convex function인 경우에만 최저점을 찾아준다.

경사 구하는 법 -> 미분을 활용한다.

<Multivariable Linear Regression>

기존 Binary 문제 :

Multivariable 문제 :

- Matrix의 곱을 활용해 간단하게 구하는 방법은?

- Matrix 장점 : 여러 줄의 x값(인스턴스)을 한번에 입력할 수 있어진다.

<Logistic (Regression) Classification>

- Linear Regression 복습

- Binary Classification

- spam Detection : Spam or Ham

- Facebook feed : show or hid

- Credit Card Fraudulent Transaction detection : legitimate or fraud

- z는 Logist Function -> 0과 1사이의 값으로 바꿔준다.

<Logistic Function의 Cost와 Gradient Descent>

- 기존 Cost Function

오른쪽 그래프와 같이 local minimum에 빠질 확률이 높다. 따라서 기존 Cost 함수를 사용할 수 없다.

새로운 Cost 함수로 변경해야됨!!

- 새로운 Cost Function

- y=0일때, y=1일때 합쳐서 정리해놓은 형태

- Minimize Cost -> Gradient Descent

<Softmax Classification : Multinomial Classification>

- Logistic Regression

- Multinomial Classification

1. 앞에서 사용한 방식

2.. Matrix를 활용해 합쳐서 구하는 방식

3. Softmax를 사용해서 0과 1사이의 확률값으로 출력 값 나타내기

4. argmax()를 사용해 하나만 1로 만드는 one-hot encoding

5. Cost Function 만드는 방법 : Cross-Entropy

6. Logist Cost vs Cross Entropy 계산

계산하는 방식 : http://melonicedlatte.com/machinelearning/2019/12/20/204900.html

엔트로피(Entropy)와 크로스 엔트로피(Cross-Entropy)의 쉬운 개념 설명 - Easy is Perfect

엔트로피는 머신러닝을 할 때, loss function(손실 함수) or cost function으로써 많이 사용됩니다. 용어에 대하여는 많이 들어보았지만 직관적으로 다가오지가 않아서 한 번 정리해보았습니다. 1. Entropy

melonicedlatte.com

'Study > Machine Learning' 카테고리의 다른 글

| CNN, RNN 모르는 부분 정리 (0) | 2021.12.07 |

|---|---|

| Deep Learning 기초 (0) | 2021.12.06 |

| 기계학습 정리 (0) | 2021.12.06 |

| pandas Dataframe 열 분리 (0) | 2021.10.13 |

| 기본 torch 함수 (tensor 형식으로 변경, torch.rand()) (0) | 2021.10.12 |